互動式 AI 虛擬助理教學:LLMAvatarTalk

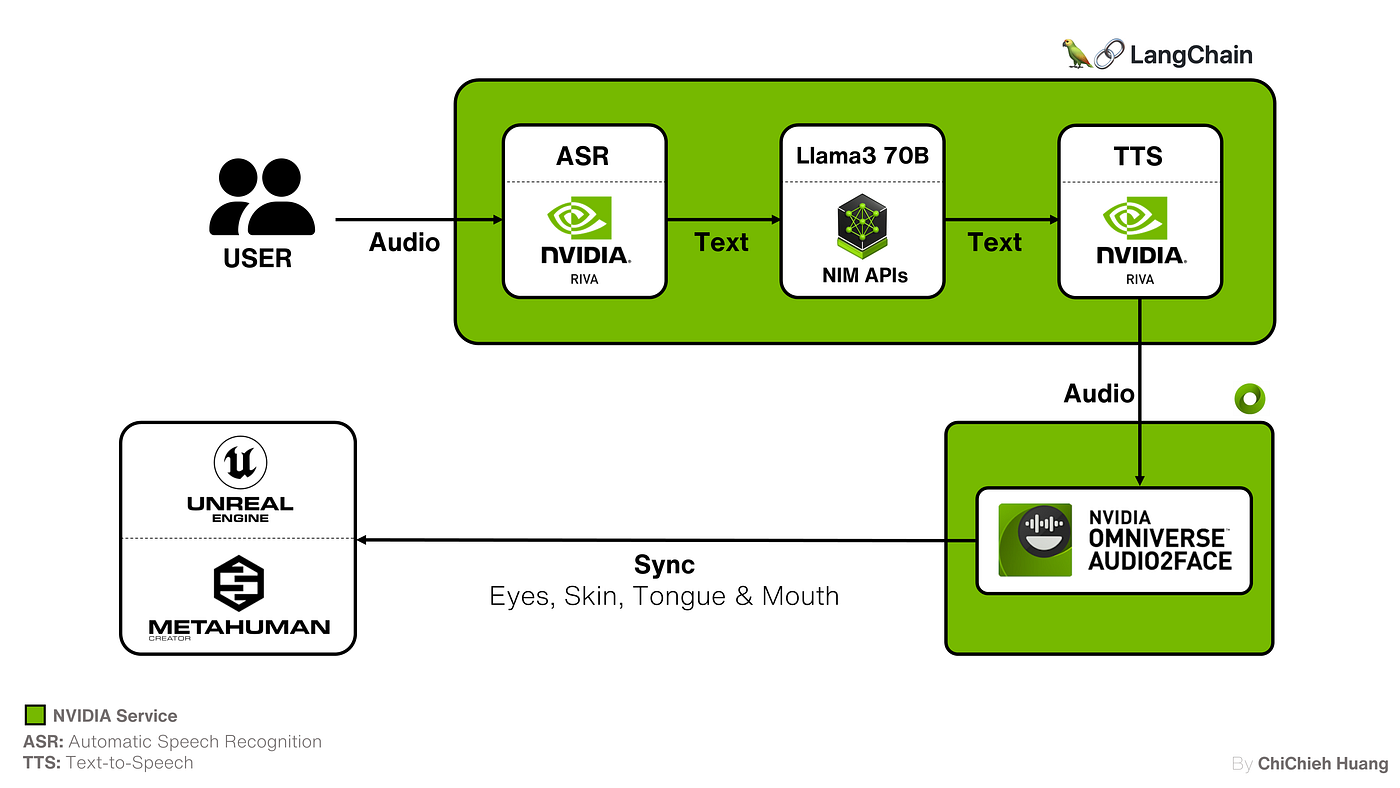

教學如何整合自動語音識別(ASR)、大型語言模型(LLM)、文字到語音(TTS)、LangChain 和音頻驅動的面部動畫(Audio2Face)與虛幻引擎的 Metahuman等技術,創建你的個人互動式 AI 虛擬助理。

互動式 AI 虛擬助理教學:LLMAvatarTalk

互動式 AI 虛擬助理教學:LLMAvatarTalk

簡介

最近受邀參加了由 NVIDIA 和 LangChain 舉辦的比賽,我在比賽中開發了一個互動式 AI 虛擬助理專案 — — LLMAvatarTalk: An Interactive AI Assistant。這個專案整合了先進的 AI 技術,讓你可以跟你所創建的 AI 虛擬助理流暢聊天,並感受到它如真人般的面部表情。

這個專案已經放在 GitHub 上,每個步驟我都有寫詳細的逐步教學。如果你對這個專案感興趣或有任何建議,歡迎查看或提交 issue 或 PR;而若這個專案有幫助到你,請不吝嗇點個 Star 支持一下,感謝大家。

另外由於這是 NVIDIA 與 LangChain 的比賽,因此我全部使用 NVIDIA 與 LangChain 的相關技術實作,你也可以依據你的需求,整合進不同的技術。

功能特色

- 語音識別 :使用 NVIDIA RIVA ASR 技術,將用戶的語音即時轉換成文字。

- 語言處理 :利用 NVIDIA NIM APIs 和先進的 LLM(如 llama3–70b-instruct)進行深入的語義理解和回應生成。

- 文字到語音 :通過 NVIDIA RIVA TTS 將生成的文字回應轉換成自然的語音輸出。

- 面部動畫 :使用 Audio2Face 技術根據語音輸出生成逼真的面部表情和動畫。

- 虛幻引擎整合 :利用 Unreal Engine 的 Metahuman 與 Audio2Face 實現實時連結,增強虛擬角色的表現力。

- LangChain :簡化 NVIDIA RIVA 和 NVIDIA NIM API 的集成,為 AI 開發提供無縫且高效的工作流程。

架構

This post is licensed under

CC BY 4.0

by the author.